自己情報量、エントロピー、KL情報量、交差エントロピーと尤度関数

machinelearning自己情報量

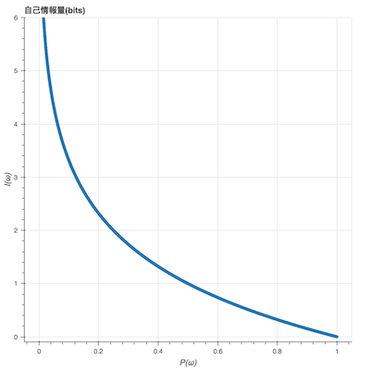

P(ω)の確率で起きる事象ωの自己情報量は以下の式で定義される。logの底を2にしてbitsで表すのが一般的。

log(P)+log(Q)=log(P*Q) より加法性がある。 例えば、サイコロで1の目が2回連続で出る(P=1/36)情報量(5.16bits)はサイコロで1の目が出る(P=1/6)情報量(2.58bits)の2倍と等しい。 確率が高ければ高いほど自己情報量は小さくなり、P(ω)=1 では0bitになる。

エントロピー

確率分布Pに従う確率変数Xのエントロピーは以下の式で定義される。情報量の平均。

これは情報を送る際に必要なビット数の平均の下限になっている。 例えば、Xが1~4の値を(0.8, 0.1, 0.06, 0.04)の確率でとるとする。 4通りなのだからそれぞれ2bits(00, 01, 10, 11)のコードで表すこともできるが、 ほとんど3や4は出ないのだからbit数を偏らせて(0, 10, 110, 111)のコードで表すと 0.81 + 0.12 + 0.063 + 0.043 = 1.3 bitsまで減らすことができる。 この場合のエントロピーは1.01bitsで、これより小さくすることはできない。

カルバック・ライブラー情報量

離散確率分布PのQに対するカルバック・ライブラー情報量は以下の式で定義される。連続確率分布では積分する。 Qの自己情報量からPの自己情報量を引いて平均を取ったもので、分布間の距離のように考えることができる。非負の値を取る。

交差エントロピー

離散確率分布PとQの交差エントロピーは以下の式で定義される。連続確率分布では積分する。 PのエントロピーにPのQに対するKL情報量を足したもの。

これはQの分布に最適化されたコードでPの分布の確率変数の情報を送ってしまった際に必要なビット数の平均の下限になっている。KL情報量が余分な分。機械学習の損失関数に使われる。

ロジスティック回帰と尤度関数/交差エントロピー誤差と勾配降下法 - sambaiz-net